妄想は大切ですが、基本のインプットも大事ですよね

おでぇかけぇでぇすかぁ~~?落ち葉の玄関掃除をした、かえるのクーの助手の「井戸中 聖」(いとなか あきら)でございます。

(クーの宿敵 Dr.ケー)

(クーの宿敵 Dr.ケー)

寒くなってまいりました。かえるのクーは今どこにいるのか知りませんが、そろそろ冬眠の準備をしていると思います。来春生還されることを強く望みます。

さて妄想(思考実験)を頭の片隅で実行しておりましたが、やはりフィードバックが完全に「ない」制御は難しいことに気が付きました。(当たり前なのでしょうか。。。わたくしにはわかりませんでした)

今回も、「伝わらない」ですが勉強&妄想を進めます

制御に関する基本勉強をもう少しして、発想を膨らませてみます。

フィードバック制御についてはすでにある程度学習しています。

いちおう工学系なので、「フィードバック」は学校で習いました。*1

フィードフォワードを勉強しよう

思考実験の発想に近いかもしれない「フィードフォワード制御」について、勉強してみます。今時では、ほとんどフィードバックと対になって説明されるくらいメジャーなのですね。

なるほど、よくわかりました。フィードフォワードは端的にいえば熟練後の特定アルゴリズム制御なのですね。学習途中にフィードフォワードするときは、フィードバックとペア使用が(ほぼ)必須なのですか。おそらくフィードフォワードは「アルゴリズム」でなく、「学習」によっても制御創成ができそうな「感じ」がします。

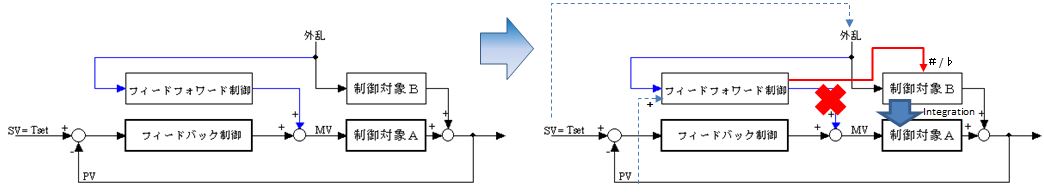

上記解説の中ではこの図が一番妄想発想に近いです。「外乱」入力は処理してエラーが一定量を超えた(未知の状況と判断された)情報そのものを入力とする考えです。制御対象Bは外乱に対処するための新規のニューラルネットワークのセットです。少し違う点は、フィードフォワード制御の結果を制御対象Aに戻す操作は行わず、制御対象Bの横からの入力とします。(この横入力は制御対象Bを変容させます)。最終的に制御対象Aと制御対象Bを「統合&圧縮」して制御対象A'にしてしまう作戦です。(なので、妄想でのフィードフォワード制御部は、外乱対応アルゴリズムではなく、外乱に対する学習誘導の「しくみ」そのもののイメージです。そした新たな外乱対応用の制御対象Cを準備します。

そう、学習後の貴方'は学習前の貴方とは、すこしだけ別人なのです。リアルでは、実は貴方が制御対象そのものなのです(神さまからみれば?)。

モデル圧縮を勉強しよう

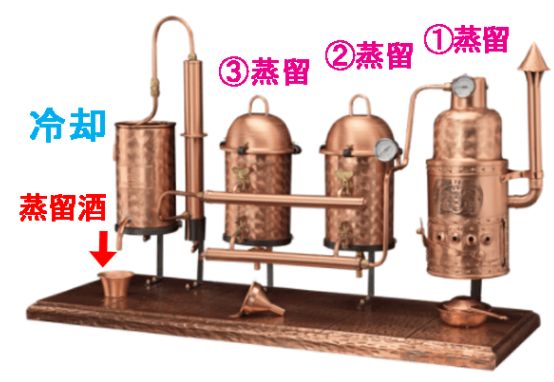

それと、中間層の「圧縮」は思考実験では必須事項だったので、この内容についても復習してみます。まずはPruning(枝刈り)とDistillation(蒸留)が候補でしょう。

学習がスパースになるように誘導して、スカスカ部分をプルーニングする感じですよね。

すこし「かすっている」くらいですが、以下の観点もおもしろそうです。

というわけで、今回はフィードフォワード制御とモデル圧縮をお勉強しました。

モデル圧縮で余剰になったニューロンをどんどん「フィードフォワード」側に一旦機能シフトして学習させ、少しエージングしたところで、蒸留やプルーニングしていきニューロンをまた減らすモデル圧縮...のループをさせれば、いい感じに高速に学習が収束していきそうな予感がします。機能的には「フィードフォワード」担当のニューロンは使いまわしの短期記憶担当のイメージです。そして学習に直接寄与するのではなく、長期記憶(≒学習)の効率化のバッファのような存在であるとすれば、脳の海馬っぽくっておもしろそうです。(実装するとそんな風に機能する「はず」:実装できればですが)

いかに「既存のフィードバック制御を破綻させずに、よりシビアな制御をするか」の観点をわたくしの自己符号化器に取り入れるよう「思考」してみます。特にラプラス変換*2と複素数計算の必要性を感じたので勉強してみます。。。(見てみました) え~、わかる予感がしない。異世界の算数です。

挫折をもう一度味わってみます。まずはここの中学数学編から、教えてもらいます。。。う、、、わたくしには小学算数編が必要ですね。

「いちねんせい」からやりなおします。えっ!?錯乱坊計算って何??

こういうネーミングセンスは大好きです

これでいいのだ!